一场由伦理争议引发的市场剧变

当OpenAI首席执行官萨姆·奥特曼在社交媒体上公开一封内部信,试图解释公司与五角大楼的合作时,一场始料未及的风暴正在移动应用市场悄然上演。这封信的核心,是OpenAI希望协助“缓和局势”,但其引发的连锁反应却截然相反。

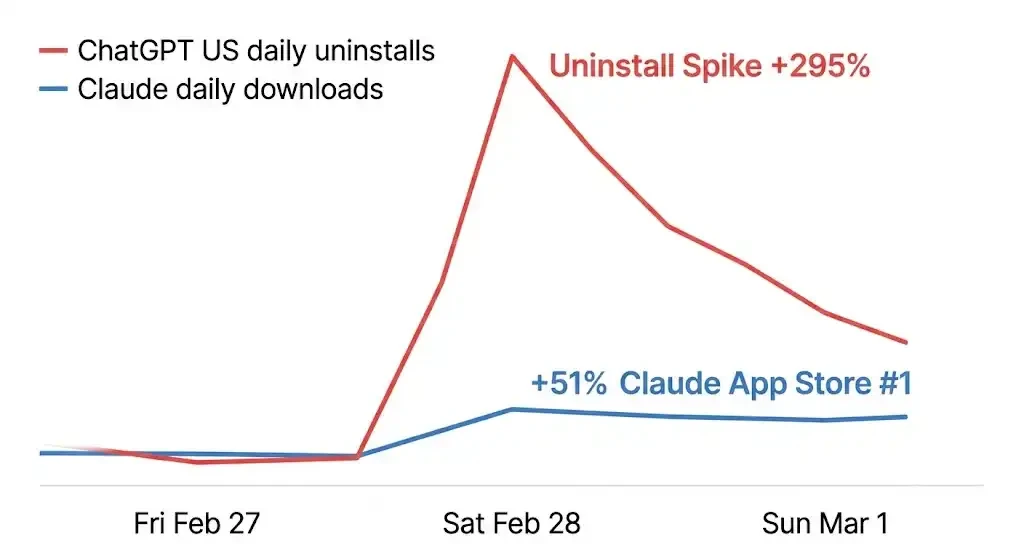

几乎在同一时间,其竞争对手Anthropic旗下的AI助手Claude,戏剧性地登上了美国App Store免费应用排行榜的首位,取代了此前长期霸榜的ChatGPT。市场数据监测机构Sensor Tower的记录揭示了这场用户迁徙的剧烈程度:短短一天之内,ChatGPT在美国的卸载量激增近300%,一星差评数量飙升超过775%。与之形成鲜明对比的是,Claude的单日下载量上涨了51%。

社交媒体上,“抵制ChatGPT”的声浪迅速蔓延。用户纷纷晒出取消订阅的截图,一个名为QuitGPT.org的网站应运而生,宣称已有超过150万人采取了行动。大量新用户的涌入甚至导致Claude服务器一度不堪重负,出现大规模宕机。

精准的产品策略:降低迁移门槛

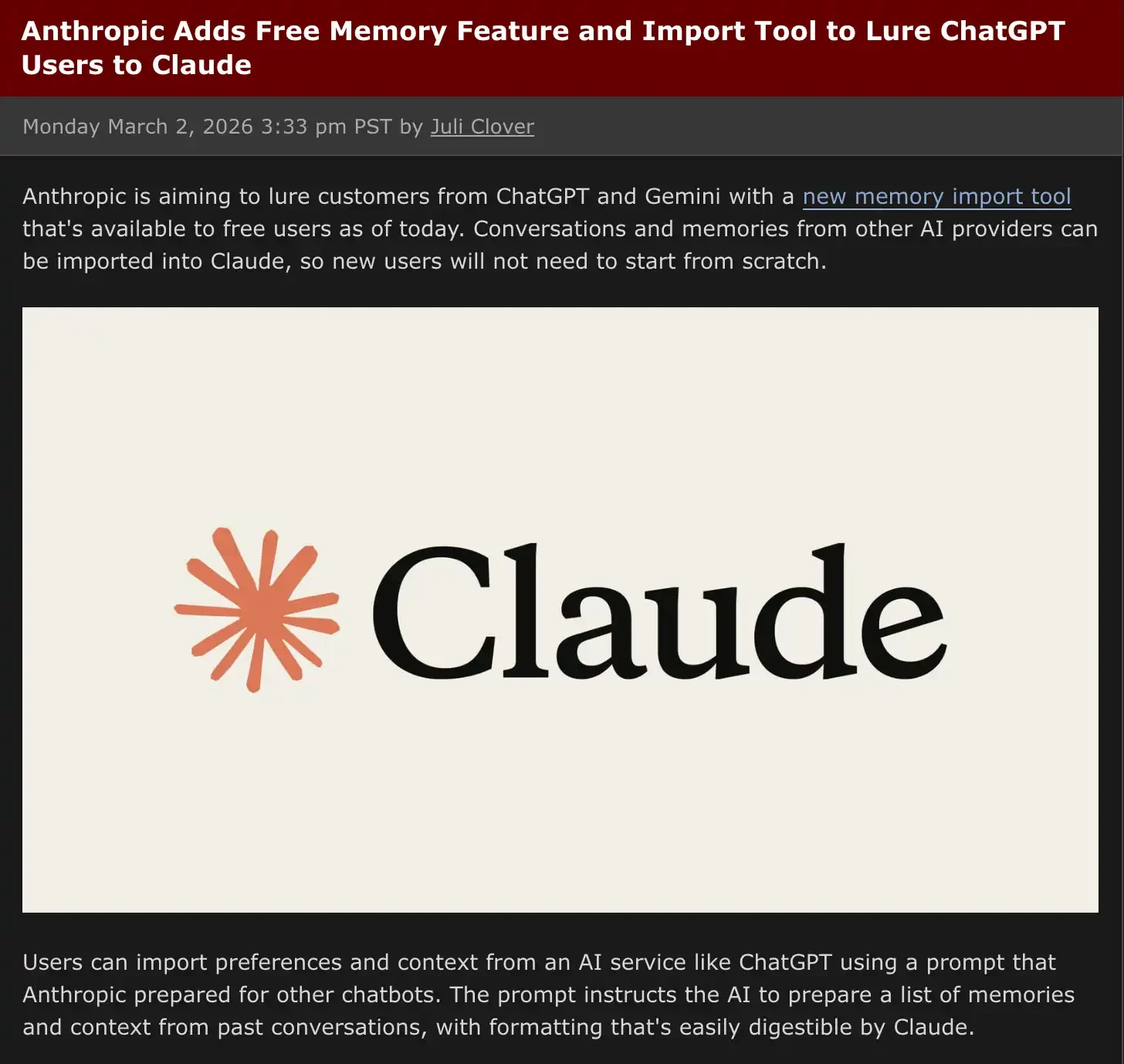

在这场用户迁徙浪潮发酵的关键时刻,Anthropic推出了一项极具针对性的功能——记忆迁移工具。该工具的设计简洁而高效:用户只需将一段特定提示词复制到ChatGPT,导出其存储的所有个人记忆和偏好设置,然后粘贴至Claude,即可实现一键导入,无缝衔接。

官网的文案直击痛点:“无需从头开始,即可切换至Claude”。这一功能的推出时机堪称完美,它精准地解决了用户切换AI助手时最大的顾虑——数据与使用习惯的迁移成本。

研究表明,超过70%的ChatGPT用户将其用于非工作场景,如日常对话、创意写作和娱乐。对于这些用户而言,AI助手积累的个人记忆和互动历史是极高的粘性壁垒。Anthropic通过这一工具,几乎将迁移成本降为零。同时,公司宣布将原本付费的记忆功能向所有免费用户开放,进一步降低了使用门槛。

用户发现:Claude并非“替代品”

然而,大量从ChatGPT迁移过来的用户很快发现,Claude并非一个简单的“平替”。社交媒体上的反馈显示,许多用户的第一印象是:“它很不一样。”

- 交互风格差异: 用户指出,Claude的回答往往更具深度和反思性,有时甚至会质疑或推进用户的提问,而非一味迎合。

- 功能侧重不同: Claude在编程、数学及深度写作任务上表现突出,但其生态相对封闭,缺乏像Voice Mode那样的语音交互或丰富的插件生态。

- 产品定位迥异: 有科技媒体评论道,Claude更像一个“有立场的工作伙伴”,而ChatGPT则更接近一个“全能的个人助手”。

这种认知差异,本可能成为用户流失的原因。但在特定的伦理争议背景下,它反而强化了用户的留存意愿:认同一家公司的价值观,使其产品的独特逻辑更易被接受。Anthropic随后公布的数据证实了这一点:免费活跃用户数较年初增长超60%,日新增注册量翻了两番。

合同之争:两种AI安全哲学的碰撞

这场市场风波的根源,始于一份价值约2亿美元的军方合同。Anthropic曾是首家将其AI模型部署至美国军方机密网络的商业公司。然而,合作因一个关键条款陷入僵局:五角大楼要求模型可用于“所有合法用途”,且不附加额外条件。

Anthropic坚持要求在合同中明确写入两项例外:禁止用于大规模监控美国公民,以及禁止用于完全自主的武器系统。由于未能就此达成一致,加之对先前军事行动中AI使用方式的质询引发军方不满,Anthropic最终被联邦政府列为“供应链安全风险”,合作终止。

随后,OpenAI迅速填补了空缺,宣布与五角大楼签约。奥特曼在内部信中强调,OpenAI与Anthropic持有相同的“红线”。但当被问及为何OpenAI成功签约而Anthropic被封禁时,奥特曼的解释点明了核心分歧:“Anthropic似乎更关注合同中的具体禁止条款,而我们则对引用现有法律框架感到满意。”

法律专家的深度剖析

法律专家对OpenAI公开的合同条款进行了细致分析,指出了潜在风险:

- 监控条款的漏洞: 合同禁止的是“无约束的”监控。专家指出,这意味着“有约束的”监控在条款上是被允许的。在现行法律下,政府完全可以通过合法途径获取公民数据并交由AI分析,这可能构成一个灰色地带。

- 武器条款的依赖性: 合同对自主武器的限制,依赖于“当法律、法规或政策要求人类控制时”这一前提。这实际上将约束力寄托于可能随时被修改的军方内部政策上,而非一个绝对禁令。

这不仅仅是商业妥协与原则坚守的区别,更是两种安全哲学的碰撞:OpenAI的底线是“不做非法之事”,而Anthropic的底线延伸至“法律尚未禁止但存在伦理风险之事”。这一分歧甚至在OpenAI内部引发了波澜,有员工公开支持Anthropic的立场。

叙事的力量:代价与回报

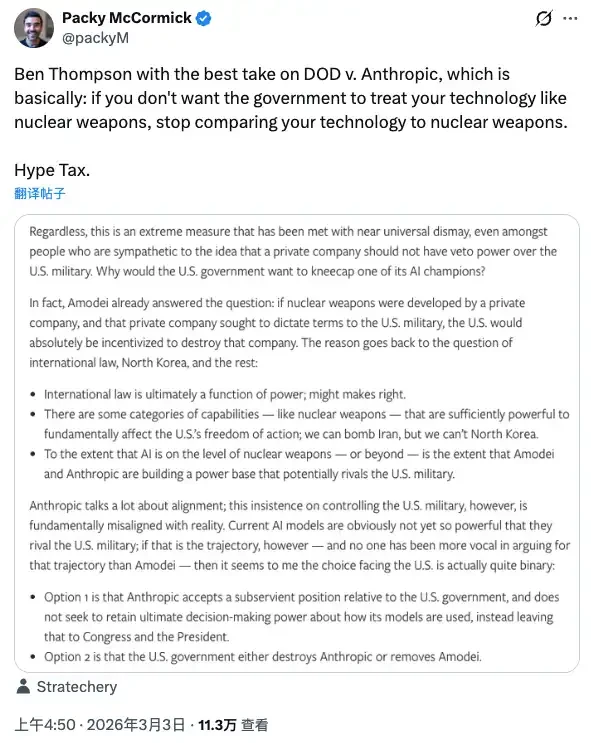

Anthropic长期以来将其使命定位为防范“文明级风险”,将前沿AI的潜在威胁与核武器相提并论。科技评论家指出,这种极端叙事在带来影响力的同时,也需支付“炒作税”——当你以如此高的标准定位自己时,权力机构也会以相应的标准来审视和要求你。

Anthropic为此付出了代价:失去巨额合同、被列入风险名单、遭到行政禁令。然而,在同一周末,这套叙事在消费者层面产生了截然相反的效果。用户用下载和卸载投票,完成了一次罕见的集体道德表态。Anthropic未花费任何公关预算,却收获了用户量的激增。

一个值得玩味的对比是:Anthropic失去的军方合同价值约2亿美元,而其目前的年化收入高达140亿美元,估值已达3800亿美元。市场给出了它的答案。

然而,一个更深层的问题依然悬而未决:当AI技术真正被深度集成到军事决策中时,无论是合同中的技术护栏,还是派驻的工程师监督,是否足以确保其被负责任地使用?这个问题的答案,尚未写进任何一份公开的合同。

🔥 这篇深度分析够不够劲?群里还有更多加密专题干货!

想跟志同道合的朋友一起聊趋势?赶紧进群→青岚免费交易社群 (电报)

💡 感谢阅读

1、市场风云变幻,以上仅为青岚姐个人的复盘与思考,不作为任何投资建议。在加密市场的长跑中,比起预测,更重要的是执行——请务必管好仓位,严带止损,愿我们且行且珍惜,在每一轮波动中稳健前行!

2、关于如何合理设置止盈止损,请点这里查看青岚姐的教程。

3、本文由青岚加密课堂整理优化,如需转载请注明出处。